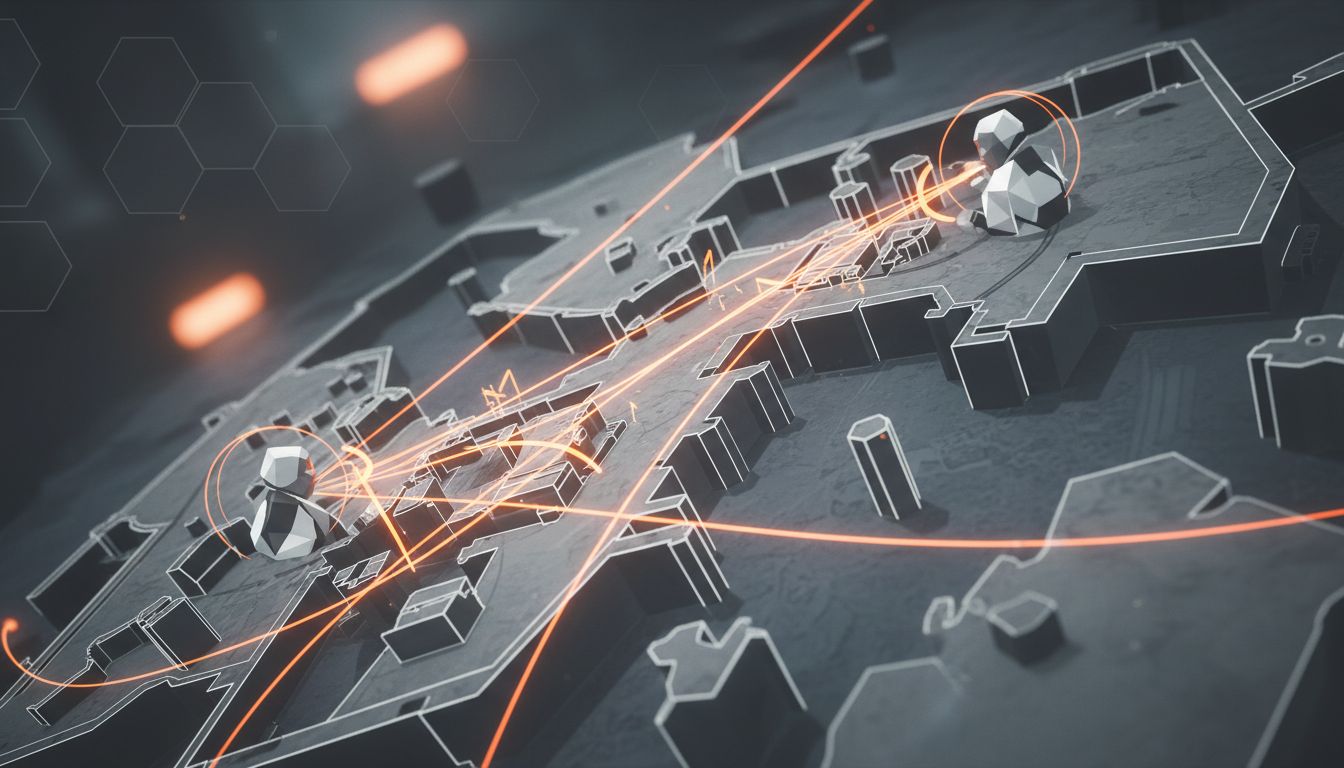

Dans l’eSport compétitif, la latence réseau n’est pas un détail : elle conditionne directement la prise de décision, la précision et la cohérence des actions en jeu. Optimiser son ping est donc une priorité opérationnelle pour toute équipe ou infrastructure orientée performance.

Au-delà du simple choix d’un “serveur rapide”, il s’agit de comprendre les mécanismes réseau, d’ajuster l’environnement local et de configurer correctement les parties privées. Cet article propose une approche pragmatique et technique pour réduire le RTT et fiabiliser vos sessions compétitives.

Comprendre le ping et la latence réelle

Le “ping” correspond au round-trip time (RTT), c’est-à-dire le temps nécessaire pour qu’un paquet fasse un aller-retour entre le client et le serveur. Plus ce RTT est faible, plus les interactions en jeu sont réactives et synchronisées.

Il est important de distinguer puissance serveur et latence réseau. Un serveur très performant mais éloigné géographiquement produira un ping élevé, car la distance physique reste un facteur déterminant dans le temps de transmission.

Dans un contexte compétitif, un serveur “rapide” est avant tout un serveur avec un RTT faible et stable. La stabilité est aussi critique que la valeur moyenne, car les variations de latence dégradent la prédictibilité du gameplay.

La distance et le choix de région serveur

La distance entre le joueur et le serveur est l’un des leviers les plus impactants. Chaque saut réseau ajoute du délai, ce qui explique pourquoi les serveurs proches géographiquement offrent généralement les meilleurs résultats.

Choisir la bonne région serveur est donc une décision stratégique, notamment pour les compétitions ou les scrims inter-équipes. Une mauvaise région peut introduire un désavantage systémique.

Ce principe est directement lié aux architectures modernes type edge computing : rapprocher le traitement de l’utilisateur réduit mécaniquement la latence. Les infrastructures eSport doivent s’aligner sur cette logique.

Optimiser son réseau local (Ethernet, Wi‑Fi 6/7)

Une connexion filaire reste la référence pour réduire les aléas. L’Ethernet élimine une grande partie des interférences et des variations propres au sans-fil.

Si le Wi‑Fi est nécessaire, les standards récents apportent des gains significatifs. Le Wi‑Fi 6/6E réduit la congestion, notamment via la bande 6 GHz, tandis que le Wi‑Fi 7 vise explicitement des latences plus faibles et une meilleure stabilité.

Pour un usage compétitif, il est recommandé de tester systématiquement en filaire afin d’isoler les problèmes. Si le ping s’améliore drastiquement, le Wi‑Fi devient le principal suspect.

Optimisation du Wi‑Fi et de l’environnement physique

Le positionnement du routeur joue un rôle direct dans la qualité du signal. Réduire les obstacles physiques (murs, mobilier dense) améliore la stabilité et diminue les fluctuations de latence.

Séparer les SSID par bande (2,4 GHz, 5 GHz, 6 GHz) permet de contrôler précisément la connexion utilisée. Pour le gaming, privilégier les bandes moins congestionnées est essentiel.

Dans les environnements denses (LAN, bureaux, événements), cette granularité devient critique pour éviter les interférences croisées et maintenir une latence constante.

Diagnostiquer la latence et les routes réseau

Des outils comme traceroute ou MTR permettent d’analyser le chemin réseau et d’identifier les points de congestion ou de perte. Ils sont indispensables pour un diagnostic avancé.

Une latence instable peut provenir d’un segment spécifique du réseau, et non du serveur final. Sans analyse de route, ces problèmes restent invisibles.

Dans un contexte eSport, intégrer ces diagnostics dans les procédures techniques permet d’anticiper les incidents avant les matchs critiques.

Lancer des parties privées sur des serveurs optimisés

Dans Fortnite, les parties privées nécessitent un compte actif dans le programme créateur et ne sont pas disponibles dans tous les modes. La configuration doit respecter des contraintes strictes.

Le code de matchmaking doit contenir entre 4 et 16 caractères, sans caractères spéciaux, et il est sensible à la casse. Une mauvaise configuration entraîne des erreurs de connexion.

La sélection de la région serveur identique pour tous les joueurs est obligatoire. C’est un point critique pour éviter les échecs de connexion et garantir un ping homogène.

Contraintes opérationnelles des matchs privés

Fortnite impose une limite de 100 joueurs par match privé. Si plus de joueurs tentent de rejoindre simultanément, une sélection aléatoire est appliquée.

Les joueurs doivent être prêts avant le lancement. Rejoindre une session déjà démarrée peut générer des erreurs ou empêcher l’accès.

Ces contraintes nécessitent une coordination stricte côté organisateurs pour garantir un déroulement fluide des scrims ou événements.

Cas pratique : Rocket League et la sélection de région

Rocket League permet la création de tournois privés via l’onglet Custom, avec sélection explicite de la région serveur. Cette étape est essentielle pour minimiser la latence.

Les parties privées avec mot de passe offrent une flexibilité opérationnelle, notamment pour les équipes multi-plateformes ou les entraînements fermés.

Comme pour Fortnite, le choix de la région la plus proche de tous les participants reste le facteur déterminant pour optimiser son ping.

Optimiser son ping repose sur une combinaison de facteurs : choix du serveur, qualité du réseau local, configuration Wi‑Fi et diagnostic des routes. Aucun levier unique ne suffit, mais leur cumul produit des gains significatifs.

Pour les parties privées, la rigueur de configuration est tout aussi importante que l’infrastructure. Région cohérente, paramètres corrects et coordination des joueurs garantissent une expérience stable et compétitive.